Dok nije sporno kako se glavno područje razvoja obrambenih tehnologija posljednjih godina koncentrira na razne robotizirane sustave i za njihovo savladavanje potrebne protumjere, ponešto je manje vidljivo natjecanje velikih sila u ovladavanju tehnologijama umjetne inteligencije u vojne svrhe. Dok se Kina usmjerava prema 2030. godini kao cilju do kojeg bi tu željeli postići svjetsku dominaciju (po kojem već kriteriju), glasno je odjeknula i nedavna izjava ruskoga predsjednika Vladimira Putina o umjetnim inteligencijama prema kojoj “tko god postane vodeći u ovoj sferi postat će vladarom svijeta“. Na ovome polju aktivno rade i Sjedinjene Američke Države te Europska unija, iako su njihovi napori tržišno razdijeljeni između državne i privatne razine istraživanja. Ova podijeljenost uvelike usporava rad i u suštinskom je neskladu s proklamiranom važnošću koju tehnologijama umjetne inteligencije (Artificial Intelligence – AI) pridaju Ruska Federacija i Kina. Pa ipak, baš se SAD i Kina trenutno smatraju vodećima na ovom polju.

Privatna poduzeća iz Sjedinjenih Američkih Država općenito ulažu masivna sredstva u razvoj novih tehnologija, među ostalim i u područje umjetnih inteligencija. Google je tako uložio oko 500 milijun USD u projekt DeepMind, dok je Microsoft u neovisni laboratorij OpenAI investirao oko milijardu američkih dolara. Obje ove investicije u osnovi predstavljaju nastojanje usporedivo svojedobnim privatnim istraživačkim naporima u okviru laboratorija kakvi su bili Bell Labs, Palo Alto Research Center ili Cisco Systems. Pri tome, ako za primjer uzmemo razvoj računarske tehnologije – tu su ipak jasno bile vidljive koristi od suradnje velikih korporativnih laboratorija, država, ali i većih poduzeća (IBM, AT&T), te tadašnjih manjih privatnih igrača (Apple, Sun). Ovako širok pristup posebno je bitan na području umjetnih inteligencija, budući se pod tim nazivom zapravo krije izuzetno široko područje koje obuhvaća svašta, od strojnoga učenja i autonomnih robota pa do raznolikih tehnologija kojima je širi cilj replicirati ili nadopuniti procese ljudske spoznaje – ne bi li se na području obrane njima omogućilo i postizanje konkretnih prednosti u ratnim situacijama.

Privatna poduzeća iz Sjedinjenih Američkih Država općenito ulažu masivna sredstva u razvoj novih tehnologija, među ostalim i u područje umjetnih inteligencija. Google je tako uložio oko 500 milijun USD u projekt DeepMind, dok je Microsoft u neovisni laboratorij OpenAI investirao oko milijardu američkih dolara. Obje ove investicije u osnovi predstavljaju nastojanje usporedivo svojedobnim privatnim istraživačkim naporima u okviru laboratorija kakvi su bili Bell Labs, Palo Alto Research Center ili Cisco Systems. Pri tome, ako za primjer uzmemo razvoj računarske tehnologije – tu su ipak jasno bile vidljive koristi od suradnje velikih korporativnih laboratorija, država, ali i većih poduzeća (IBM, AT&T), te tadašnjih manjih privatnih igrača (Apple, Sun). Ovako širok pristup posebno je bitan na području umjetnih inteligencija, budući se pod tim nazivom zapravo krije izuzetno široko područje koje obuhvaća svašta, od strojnoga učenja i autonomnih robota pa do raznolikih tehnologija kojima je širi cilj replicirati ili nadopuniti procese ljudske spoznaje – ne bi li se na području obrane njima omogućilo i postizanje konkretnih prednosti u ratnim situacijama.

Upravo ta postojeća industrijska infrastruktura razlog je zašto izgleda da SAD sada vode u ovoj tehnološkoj utrci. Dok Kina kao američku prednost vidi postojeća tehnološka poduzeća, te napretke dostignute izradom kompleksnih strateških igara, iz SAD kao kinesku prednost navode slobodan pristup velikim količinama informacija, ali i sposobnost autokratskog oblika vladanja da sve tehnološke kapacitete društva upregne u istome smjeru bez mnogo osvrtanja na prava i privatnost građana. Uglavnom, riječ je o sredstvima za koje se ove veljače iz američkog Pentagona čulo da su “u poziciji promijeniti karakter budućeg bojišta“, dok pravu prirodu ovog odmjeravanja dobro ilustrira izjava generala Jacka Shanahana, osobe koja je u Pentagonu zadužena za pitanja razvoja umjetnih inteligencija, koji je 30. kolovoza ove godine izjavio: “Ono što ne želim vidjeti je budućnost u kojoj naši potencijalni suparnici imaju snage potpuno osposobljene za korištenje umjetnih inteligencija, a mi to nemamo“.

Upravo ta postojeća industrijska infrastruktura razlog je zašto izgleda da SAD sada vode u ovoj tehnološkoj utrci. Dok Kina kao američku prednost vidi postojeća tehnološka poduzeća, te napretke dostignute izradom kompleksnih strateških igara, iz SAD kao kinesku prednost navode slobodan pristup velikim količinama informacija, ali i sposobnost autokratskog oblika vladanja da sve tehnološke kapacitete društva upregne u istome smjeru bez mnogo osvrtanja na prava i privatnost građana. Uglavnom, riječ je o sredstvima za koje se ove veljače iz američkog Pentagona čulo da su “u poziciji promijeniti karakter budućeg bojišta“, dok pravu prirodu ovog odmjeravanja dobro ilustrira izjava generala Jacka Shanahana, osobe koja je u Pentagonu zadužena za pitanja razvoja umjetnih inteligencija, koji je 30. kolovoza ove godine izjavio: “Ono što ne želim vidjeti je budućnost u kojoj naši potencijalni suparnici imaju snage potpuno osposobljene za korištenje umjetnih inteligencija, a mi to nemamo“.

Vojne uporabe umjetnih inteligencija

Dok se svi slažu kako je riječ o tehnologiji koja ima snagu iznova postaviti globalne omjere snaga, tek treba vidjeti kako će zapravo izgledati njena praktična primjena. Američki stručnjak Michael Horowitz je vojne primjene ove tehnologije podijelio u tri načelna smjera: prvi od njih je omogućavanje strojevima da djeluju bez ljudskoga nadzora, drugi obuhvaća obradu i interpretiranje velikih količina podataka, dok se treći odnosi na pomaganje izvoditeljima, ako ne i samostalno provođenje zapovijedanja i nadzora u borbenim situacijama.

Dok se svi slažu kako je riječ o tehnologiji koja ima snagu iznova postaviti globalne omjere snaga, tek treba vidjeti kako će zapravo izgledati njena praktična primjena. Američki stručnjak Michael Horowitz je vojne primjene ove tehnologije podijelio u tri načelna smjera: prvi od njih je omogućavanje strojevima da djeluju bez ljudskoga nadzora, drugi obuhvaća obradu i interpretiranje velikih količina podataka, dok se treći odnosi na pomaganje izvoditeljima, ako ne i samostalno provođenje zapovijedanja i nadzora u borbenim situacijama.

(1) Autonomija strojeva na bojištu već je dugo san obrambene industrije. No, da bi ona imala smisla (i da se ne bi svela na automatsko izvođenje ratnih zločina) potrebno je mnogo više od samog tumaranja borbenih sustava terenom tijekom sukoba – traži se prepoznavanje uzoraka i navigacija, ali i brojne više sposobnosti (recimo, koordinacija s ostalim elementima bojišta). Današnji sustavi umjetne inteligenije i kad budu uspješni zapravo su krhke učinkovitosti – obično usko specijalizirani, a često i efikasni samo u jasno definiranom okolišu, bez prave potrebe za samostalnim učenjem ili kompleksnim zaključivanjem. Dobar primjer za ovakve oružne sustave s umjetnom inteligencijom su anti-radarski projektili sposobni duže vrebati paljenje protivničkih senzora, te brzometni sustavi za obranu brodova i kopnenih instalacija od svekolikih prijetnji iz zraka.

Područje posebnog razvoja tu predstavljaju sustavi za automatiziranu manipulaciju, koji su sposobni prvo prepoznati stvari u prostoru i onda ih uhvatiti te njima nešto raditi – recimo, prepoznati postojanje barikade sastavljene od raznolikih predmeta, koju se onda uspije rastaviti hvatajući i oslobađaući pojedine njene dijelove. Ovo je sposobnost koju su za autonomne robote demonstrirali sredinom ovog mjeseca u Istraživačkom laboratoriju Kopnenih snaga SAD (Army Research Laboratory – ARL) u mjestu Adelphi, savezna država Maryland – u okviru programa “Robotics Collaborative Technology Alliance”. Nakon strojnog učenja i korištenja principa tzv. “intuitivne fizike”, njihovi su roboti RoMan sposobni na nepoznatom terenu manipulirati određenim rasponom slučajnih premeta, dok se za ubuduće nastoji postići da ovi autonomni sustavi budu u stanju raditi brže, uz korištenje raznolikih oslonaca te vlastite težine za manipuliranje sve šire palete predmeta, na način kako i ljudi rade takve poslove.

(2) Bitan preduvjet za uspješno djelovanje je i svijest o stanju stvari na bojištu. Imamo li u vidu da je davne 2011. godine tadašnjih oko 11.000 bespilotnih letjelica u američkoj vojnoj uporabi snimilo preko 327.000 sati video-materijala – a sve su te brojke posljednjih godina eksplodirale – jasno je da obavještajna obrada svih tih materijala predstavlja itekako zanimljivo područje za uporabu umjetnih inteligencija. Navodno su takva programska rješenja još 2015. godine nadišla ljudski učinak u općoj klasifikaciji slika, dok se između 2015. i 2018. radikalno poboljšao i učinak strojnog razlučivanja sastavnih objekata na individualnim analiziranim slikama. Iako je samo prepoznavanje uočenih objekata još upitno, te podložno brojnim pogreškama, upravo su to polja intenzivnog razvoja te istraživanja.

U veljači 2017. Pentagon je proglasio kako njihovi algoritmi i ovaj posao “mogu obavljati na razini bliskoj ljudskoj“, te je uspostavio tim za “algoritmičko ratovanje”, poznat kao “Projekt pouzdanik” (“Project Maven”) – koji je trebao strojnim učenjem i drugim tehnikama biti u stanju identificirati objekte te sumnjive aktivnosti, za početak iz raznolikih materijala nastalih tijekom ratovanja protiv Islamske države. Iako je cilj bio stvaranje “uporabljivih obavještajnih podataka” (“actionable intelligence“), upućeni tvrde kako mu je učinkovitost zapravo bila marginalna, s posebnim naglaskom na velik broj lažnih pogodaka u vizualnom prepoznavanju. Ipak, bio je to tek početak, dok danas britansko poduzeće Earth-i za svoj sustav tvrdi da je iz satelitskih fotografija vojnih baza sposoban identificirati i do 98 posto različitih varijanti vojnih letjelica.

U veljači 2017. Pentagon je proglasio kako njihovi algoritmi i ovaj posao “mogu obavljati na razini bliskoj ljudskoj“, te je uspostavio tim za “algoritmičko ratovanje”, poznat kao “Projekt pouzdanik” (“Project Maven”) – koji je trebao strojnim učenjem i drugim tehnikama biti u stanju identificirati objekte te sumnjive aktivnosti, za početak iz raznolikih materijala nastalih tijekom ratovanja protiv Islamske države. Iako je cilj bio stvaranje “uporabljivih obavještajnih podataka” (“actionable intelligence“), upućeni tvrde kako mu je učinkovitost zapravo bila marginalna, s posebnim naglaskom na velik broj lažnih pogodaka u vizualnom prepoznavanju. Ipak, bio je to tek početak, dok danas britansko poduzeće Earth-i za svoj sustav tvrdi da je iz satelitskih fotografija vojnih baza sposoban identificirati i do 98 posto različitih varijanti vojnih letjelica.

Poseban je naglasak tu stavljen na ustrajno praćenje, koje daje sposobnost razlikovanja redovitih pojava od nečeg izvanrednog – bilo da su tu u pitanju premještanja letjelica koja se promatra temeljem vizualnih podataka, ili traženje potencijalnih terorista u masama stanovnika, recimo temeljem podataka iz sustava mobilne telefonije. Upravo je ovako, temeljem dokumenata koji su 2012. iscurili iz američke NSA, na području Pakistana djelovao sustav Skynet, ne bi li prema uzorcima ponašanja (kretanja od gradova prema sumnjivim područjima, praćena čestim gašenjima ili izmjenama telefona) uočio potencijalne kurire tamošnjih terorističkih mreža. Kako je napomenuo Alex Younger, čelnik britanske službe M6, “mase podataka kombinirane s modernim analitičkim alatima čine moderni svijet prozirnim” – da bi temu nadopunio Richard Barrons, umirovljeni britanski general, izjavom: “Obavještajne stvari se počinju pomicati iz staroga svijeta, gdje su zapovjednici postavljali pitanje, da bi onda obavještajne strukture koristile svoja sredstva prikupljanja za iznalaženje odgovora, prema svijetu u kojem su svi odgovori već… u oblaku podataka“. I tu nije suštinska razlika da li se na kraju analiziraju podaci podrijetlom od protivnika, ili mase vlastitih logističkih podataka u svrhu predviđanja tehničkih problema ili kvarova.

Poseban je naglasak tu stavljen na ustrajno praćenje, koje daje sposobnost razlikovanja redovitih pojava od nečeg izvanrednog – bilo da su tu u pitanju premještanja letjelica koja se promatra temeljem vizualnih podataka, ili traženje potencijalnih terorista u masama stanovnika, recimo temeljem podataka iz sustava mobilne telefonije. Upravo je ovako, temeljem dokumenata koji su 2012. iscurili iz američke NSA, na području Pakistana djelovao sustav Skynet, ne bi li prema uzorcima ponašanja (kretanja od gradova prema sumnjivim područjima, praćena čestim gašenjima ili izmjenama telefona) uočio potencijalne kurire tamošnjih terorističkih mreža. Kako je napomenuo Alex Younger, čelnik britanske službe M6, “mase podataka kombinirane s modernim analitičkim alatima čine moderni svijet prozirnim” – da bi temu nadopunio Richard Barrons, umirovljeni britanski general, izjavom: “Obavještajne stvari se počinju pomicati iz staroga svijeta, gdje su zapovjednici postavljali pitanje, da bi onda obavještajne strukture koristile svoja sredstva prikupljanja za iznalaženje odgovora, prema svijetu u kojem su svi odgovori već… u oblaku podataka“. I tu nije suštinska razlika da li se na kraju analiziraju podaci podrijetlom od protivnika, ili mase vlastitih logističkih podataka u svrhu predviđanja tehničkih problema ili kvarova.

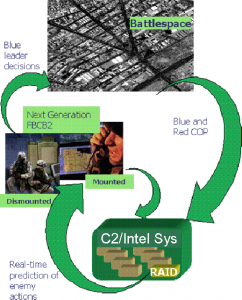

(3) Treći smjer utjecaja tehnologije umjetnih inteligencija predstavlja njihova uporaba u procesima donošenja odluka, od taktičke razine na terenu pa sve do strateških razina u višim državnim sferama. Dobar primjer ovdje predstavlja sustav nazvan “Sjeverna strijela” (“Northern Arrow”) izraelskog poduzeća UNIQAI, kao jedno od brojnih rješenja za pružanje pomoći zapovjednicima pri planiranju misija. Riječ je o sustavima za obradu velikih količina podataka o varijablama misija – protivničkim položajima, dometima naoružanja, potrošnji goriva, prohodnosti terena i vremenskim prilikama – podatke koje se inače dobiva uvidom u karte, stručne tablice i tehničke priručnike, ovoga puta dorađene i iskustvima konkretnih zapovjednika. Tim temeljem onda ekspertni sustavi poput izraelskog Northern Arrow ili američkog CADET brže od prosječnih ljudi dolaze do konkretnih akcijskih opcija, koje se stavlja pred donosioce odluka zajedno s objašnjenjem puta kojim se došlo do pojedinih zaključaka.

Iako se takve sustave tradicijski smatra primjerima umjetnih inteligencije, oni pretežito koriste determinističke metode, kojima se istim unosom uvijek dolazi i do istih rezultata (što neki uspoređuju s djelovanjem računala još od sustava ENIAC, kojim se 1940-tih izrađivalo tablice gađanja) – dok bi današnji sustavi planiranja ipak trebali biti sposobni izaći na kraj i s određenom količinom nejasnoća, slučajnosti i nedostatka konkretnih informacija. Dobar primjer takvog modernog sustava je “Real-time Adversarial Intelligence and Decision-making” (RAID), kojeg je prije petnaestak godina isprobavala američka DARPA (Defense Advanced Research Projects Agency). Riječ je o programskom rješenju koje je nastojalo predviđati ciljeve, kretanje i psihologiju neprijateljskih snaga do pet sati u budućnost – što je postizano specifičnim tipom teorije igara, gdje se probleme cijepalo na manje segmente i onda njih proigravalo štedeći procesorsku snagu potrebnu za izračune. Nakon čistih laboratorijskih usporedbi s ljudima/planerima, ovaj je sustav bio isprobavan i terenski, tijekom probnih dvosatnih bitaka u Bagdadu u kojima se timove ljudi suprotstavljalo bilo timovima ljudi ili skupinama koje je vodio sustav RAID – gdje se pokazalo da i nije lako razlikovati učinak ljudi nasuprot učinka naprednog strojnog planiranja.

Iako se takve sustave tradicijski smatra primjerima umjetnih inteligencije, oni pretežito koriste determinističke metode, kojima se istim unosom uvijek dolazi i do istih rezultata (što neki uspoređuju s djelovanjem računala još od sustava ENIAC, kojim se 1940-tih izrađivalo tablice gađanja) – dok bi današnji sustavi planiranja ipak trebali biti sposobni izaći na kraj i s određenom količinom nejasnoća, slučajnosti i nedostatka konkretnih informacija. Dobar primjer takvog modernog sustava je “Real-time Adversarial Intelligence and Decision-making” (RAID), kojeg je prije petnaestak godina isprobavala američka DARPA (Defense Advanced Research Projects Agency). Riječ je o programskom rješenju koje je nastojalo predviđati ciljeve, kretanje i psihologiju neprijateljskih snaga do pet sati u budućnost – što je postizano specifičnim tipom teorije igara, gdje se probleme cijepalo na manje segmente i onda njih proigravalo štedeći procesorsku snagu potrebnu za izračune. Nakon čistih laboratorijskih usporedbi s ljudima/planerima, ovaj je sustav bio isprobavan i terenski, tijekom probnih dvosatnih bitaka u Bagdadu u kojima se timove ljudi suprotstavljalo bilo timovima ljudi ili skupinama koje je vodio sustav RAID – gdje se pokazalo da i nije lako razlikovati učinak ljudi nasuprot učinka naprednog strojnog planiranja.

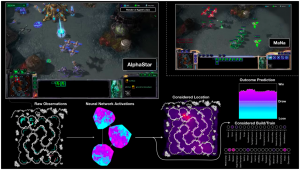

Sličnim se praktičnim putem želi voditi i kompleksne računalne sustave koji su, pokazujući ponekad i neočekivanu kreativnost, uspjeli pobijediti vrhunske ljudske igrače kineske igre Go u ožujku 2016. (AlphaGo iz laboratorija DeepMind) i izuzetno kompleksne računalne igre Starcraft II u prosincu 2018. (AlphaStar laboratorija DeepMind) – gdje su ti primjeri umjetnom inteligencijom podržanog strateškog promišljanja pobudili poseban interes i kineske Akademije vojnih znanosti. Ideja je da se tim temeljem formiraju masivni sustavi za simuliranje u gotovo realnom vremenu, koji bi bili u stanju da temeljeno na računalnim oblacima vrte virtualne simulacije pojedinih konkretnih operativnih okoliša, tzv. “sintetičke operativne okoliše”, kojima bi se pokušavalo predviđati neposredno predstojeće razvoje u konkretnoj borbenoj stvarnosti. Pa ipak, pri ovakvim razmatranjima prije svega treba zadržati određenu dozu suzdržanosti. Naime, još je tu riječ o vrlo novom tehnološkom sklopu čija je budućnost zapravo još neizvjesna – gdje su moguće i masivne greške u očekivanjima. A baš njih dobro opisuje izjava Thomasa Watsona, tadašnjeg šefa poduzeća IBM, koji je 1943. izjavio: “Mislim da na svijetu možda postoji tržište za pet elektroničkih računala“.

Sličnim se praktičnim putem želi voditi i kompleksne računalne sustave koji su, pokazujući ponekad i neočekivanu kreativnost, uspjeli pobijediti vrhunske ljudske igrače kineske igre Go u ožujku 2016. (AlphaGo iz laboratorija DeepMind) i izuzetno kompleksne računalne igre Starcraft II u prosincu 2018. (AlphaStar laboratorija DeepMind) – gdje su ti primjeri umjetnom inteligencijom podržanog strateškog promišljanja pobudili poseban interes i kineske Akademije vojnih znanosti. Ideja je da se tim temeljem formiraju masivni sustavi za simuliranje u gotovo realnom vremenu, koji bi bili u stanju da temeljeno na računalnim oblacima vrte virtualne simulacije pojedinih konkretnih operativnih okoliša, tzv. “sintetičke operativne okoliše”, kojima bi se pokušavalo predviđati neposredno predstojeće razvoje u konkretnoj borbenoj stvarnosti. Pa ipak, pri ovakvim razmatranjima prije svega treba zadržati određenu dozu suzdržanosti. Naime, još je tu riječ o vrlo novom tehnološkom sklopu čija je budućnost zapravo još neizvjesna – gdje su moguće i masivne greške u očekivanjima. A baš njih dobro opisuje izjava Thomasa Watsona, tadašnjeg šefa poduzeća IBM, koji je 1943. izjavio: “Mislim da na svijetu možda postoji tržište za pet elektroničkih računala“.

Kako nadzirati ovu buduću tehnologiju?

Ako tehnologija umjetnih inteligencija po svojem značaju za sektor obrane i stvarno bude u rangu tehnologije nuklearnih oružja, kako mnogi predviđaju, onda bi možda od koristi mogli biti i načelni principi kojima se ovladalo “nuklearnom prijetnjom”. Prvenstveno je naglasak tu bio na (1) odvraćanje, (2) kontrolu naoružanja, te (3) mjere sigurnosti. Kao prvo, faktor odvraćanja je kod nuklearnog oružja bio utjecajan zbog opće svijesti o globalnim posljedicama korištenja takvog oružja – no, u slučaju umjetnih inteligencija ovakvi opći štetni utjecaji nisu jasno prepoznatljivi i jasni, ako i potencijalno postoje. Kao drugo, sustavi kontrole naoružanja iz doba Hladnog rata počivali su na općoj transparentnosti. Pa ipak, za razliku od nuklearnog naoružanja, programski kod pojedinih sustava umjetne inteligencije nije vidljiv iz satelita, a ako i bude pokazan suprotnoj strani – vjerojatno je da će se time ujedno odati i njegove osobine te učinkovitost. I time na raspolaganju ostaje samo navedeni treći element – sigurnosne mjere koje osiguravaju da se ova sredstva ne koriste bez posebne pažnje i autorizacije. Ipak, sigurnosne mjere prikladne za kontrolu tehnologije umjetnih inteligencija tek treba razviti – i to s naglaskom na opće ljudske svrhe njihova korištenja, koje usprkos vojnim namjenama ipak moraju biti i otporne na zavaravanja, te dovoljno jasne da se njihov rad barem načelno može pratiti (uz razumijevanje načina na koji se dolazi do pojedinačnih odluka).

Ako tehnologija umjetnih inteligencija po svojem značaju za sektor obrane i stvarno bude u rangu tehnologije nuklearnih oružja, kako mnogi predviđaju, onda bi možda od koristi mogli biti i načelni principi kojima se ovladalo “nuklearnom prijetnjom”. Prvenstveno je naglasak tu bio na (1) odvraćanje, (2) kontrolu naoružanja, te (3) mjere sigurnosti. Kao prvo, faktor odvraćanja je kod nuklearnog oružja bio utjecajan zbog opće svijesti o globalnim posljedicama korištenja takvog oružja – no, u slučaju umjetnih inteligencija ovakvi opći štetni utjecaji nisu jasno prepoznatljivi i jasni, ako i potencijalno postoje. Kao drugo, sustavi kontrole naoružanja iz doba Hladnog rata počivali su na općoj transparentnosti. Pa ipak, za razliku od nuklearnog naoružanja, programski kod pojedinih sustava umjetne inteligencije nije vidljiv iz satelita, a ako i bude pokazan suprotnoj strani – vjerojatno je da će se time ujedno odati i njegove osobine te učinkovitost. I time na raspolaganju ostaje samo navedeni treći element – sigurnosne mjere koje osiguravaju da se ova sredstva ne koriste bez posebne pažnje i autorizacije. Ipak, sigurnosne mjere prikladne za kontrolu tehnologije umjetnih inteligencija tek treba razviti – i to s naglaskom na opće ljudske svrhe njihova korištenja, koje usprkos vojnim namjenama ipak moraju biti i otporne na zavaravanja, te dovoljno jasne da se njihov rad barem načelno može pratiti (uz razumijevanje načina na koji se dolazi do pojedinačnih odluka).

Iako je utrošak novaca američkog Pentagona za razvoj AI tehnologija iznosio tek djelić u usporedbi prema 20-30 milijardi USD koje su tu 2016. godine investirale američke privatne kompanije – državno sudjelovanje tu ipak ima velik značaj te utjecaj. I dok zapadne države načelno inzistiraju na zadržavanju ljudi u petlji odlučivanja raznolikih sustava s umjetnim inteligencijama, jasno je da taj uvjet ipak bitno usporava djelovanje takvih sklopova. Naravno, u vojnim primjenama postojat će težnja za ubrzavanjem procesa odlučivanja te davanja maksimalne autonomije ovakvim, možda i nedorečenim sustavima – što je izazov s kojim tek treba izaći na kraj u praksi. Dok Pentagon u tu svrhu planira zaposliti i etičare, pojedini stručnjaci savjetuju kako se rješenje možda krije u unošenju određene temeljne vrijednosne orijentacije u same buduće sustave umjetne inteligencije, gdje bi se ipak trebalo osigurati prednost pojedinih općih ljudskih interesa pred radnim ciljevima te hladnom strojnom logikom.